2023 ist das große Jahr der Künstlichen Intelligenz. ChatGPT ist mittlerweile vielen ein Begriff und immer mehr Apps stellen KI-Assistenten bereit. Doch nicht für alle ist diese Entwicklung ein Segen. Manche Berufe scheinen langfristig in Gefahr und Künstler sorgen sich um KI-Tools, die oft ohne ausdrückliche Erlaubnis mit ihren Werken lernen. Nightshade sieht sich als Antwort darauf. Sie soll KI-Crawler nicht daran hindern, Bilder zu durchsuchen, sondern die KI bewusst vergiften. Wir erklären euch, wie dies funktioniert und wohin diese Entwicklung führen könnte.

Hierbei handelt es sich übrigens noch nicht um ein öffentlich publiziertes Tool, sondern einem Projekt an der Universität von Chicago unter der Leitung von Professor Ben Zhao. Im Oktober veröffentlichte das Team eine Auswertung ihrer Tests mit Nightshade.

Was ist Nightshade überhaupt?

Der Name „Nightshade“ oder zu deutsch „Nachtschatten“ ist nicht zufällig gewählt. Beim schwarzen Nachtschatten handelt es sich nämlich um eine sehr giftige Pflanze. Sogar die Tribute von Panem haben die fiktive „Nachtriegel“-Pflanze bewusst zum Teil nach dieser Pflanze benannt. Genau so soll auch Nightshade Bilder zu giftigen Beeren machen, um Bilder für die KI-Tools zu vergiften.

Um qualitativen Output zu erzeugen, muss eine Künstliche Intelligenz nämlich mit riesigen Datenmengen trainieren. Nur in wenigen Fällen beschränken sich Bild-KIs aber auf Daten, für die sie ein Einverständnis der Urheber besitzen. Stattdessen wühlen sich die Crawler der Bild-KIs durch das Internet, um dort ihre Trainingsdaten zu bekommen. Auf der einen Seite ist das sehr clever: Ein quasi endloser Fundus an Trainingsdaten, der sehr ungefiltert, damit aber auch sehr vielfältig ist. Viele Künstler fühlen sich dadurch aber ihres geistigen Eigentums beraubt.

Um dies zu schützen, kommt Nightshade ins Spiel. Mit dem Tool können Künstler ihre Bilder auf eine Art manipulieren, die dem Betrachter nicht auffällt, aber geschickt genug manipuliert, um generative Bild-KIs in die irre zu führen.

So verändert Nightshade die Bilddaten

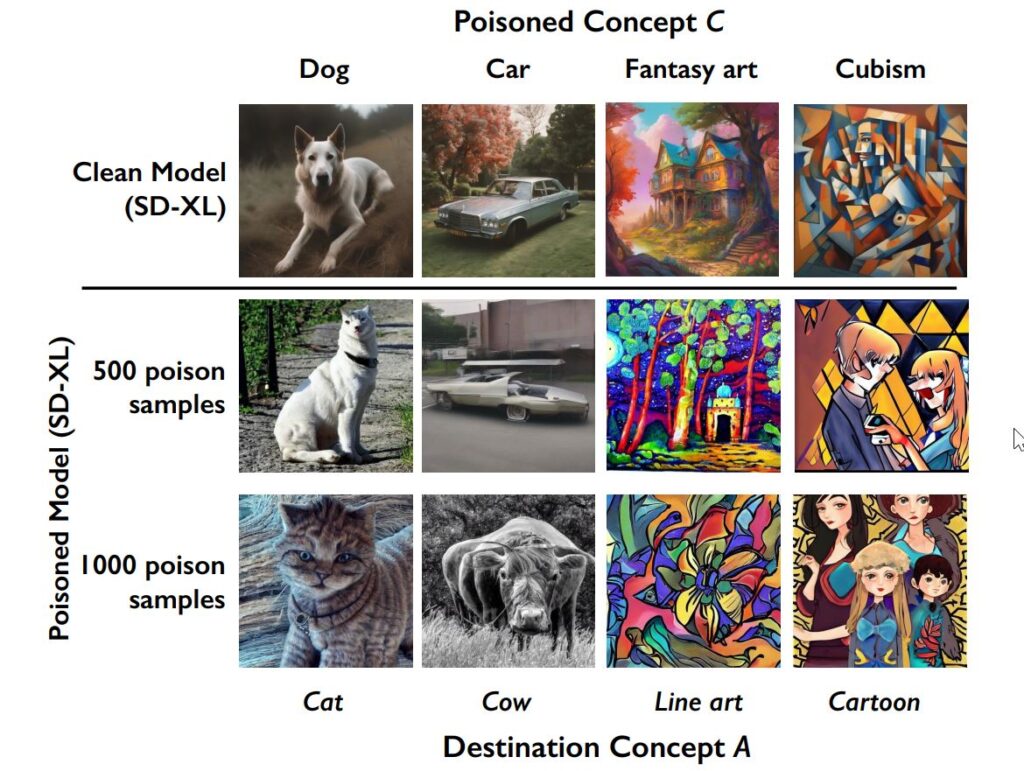

Nightshade verändert die Bilddaten so, dass sie gegenüber der menschlichen Betrachter wie gewollt erscheinen. Gegenüber der KI bringt sie hingegen bewusst Zuordnungen durcheinander. In der Praxis bedeutet dass, dass etwa Bilder für Hunde mit optischen Daten die eigentlich zu Katzen gehören vergiftet werden. Neben bestimmten Objekten beeinflusst Nightshade aber auch Stile. Ein klassischer Fantasy Stil bekommt Daten für „Line Art“, sodass eine komplette Stilrichtung zu einer falschen Darstellung führt.

Die vergifteten Daten sind dabei übrigens bewusst darauf fokusiert, mit wenig „vergifteten“ Daten einen größtmöglichen Einfluss auf die Bildgenerierung zu erzielen, dabei aber zugleich erfolgreich durch Filter zu gelangen. Dafür verknüpft Nightshade falsche Daten mit den relevantesten Prompts für die Bildgenerierung. Die Ergebnisse des Forschungsteams empfehlen eine Nutzung solcher Tools allerdings selbst nur als letzte Wahl, um sich gegenüber generativer KI zu wehren.

Startschuss zum Wettrüsten?

Dass den KI-Crawlern der Kampf angesagt wird, verwundert nur wenig. Selbst die aktuell bekannteste Bild-KI Midjourney bedient sich sehr ungeniert im Internet für Trainingsdaten. Zudem erreichen die KI-Tools langsam eine Qualität, die sie für immer mehr Anwendungsbereiche interessant machen. Auch wir haben bereits bei einigen Artikeln auf KI statt Stock-Bilder gesetzt.

Ebenso wenig würde es aber auch verwundern, wenn Nightshade damit auch das gegenseitige Wettrüsten startet. Dass Midjourney und Co auf Nightshade oder ähnliche Programme reagieren ist klar. Irgendwo finden sie ihre Wege, die Manipulationen von Nightshade zu umgehen. Das veranlasst Tools wie Nightshade wiederum dazu, neue Wege zur Vergiftung der KI-Modelle zu finden.

Allerdings: Viele der großen Bild-KIs haben bereits strengere Filter eingeführt. Zumindest bekannte Künstler zu kopieren ist zunehmend erschwert und auch die Erzeugung potentiell anstößiger Inhalte blockiert.

Hat Nightshade eine Zukunft?

Zum Problem für die Urheber könnte ausgerechnet die recht statische Natur vieler Internet-Inhalte werden. Bei einem Wettrüsten müssen die Urheber nämlich auch regelmäßig ihre Bilder updaten und wohl auch neu hochladen. Ein Aufwand der sich summiert und vermutlich kaum rentiert. Der Gegenwert ist eher ein ideeller: Den KI-Modellen die Stirn zu bieten.

Auf lange Sicht braucht es aber andere, langfristigere Wege, um das geistige Eigentum zu schützen. Die KI-Welle ist so plötzlich hereingebrochen, dass es aktuell noch keinen wirklichen rechtlichen Rahmen für den Einsatz von ChatGPT, Midjourney und ähnlichen Tools gibt. Effektiv stellt eine KI außerdem auch keine Kopien bestehender Kunstwerke zur Verfügung. Das ist ein ganz neuer rechtlicher Kontext. Schließlich bestrafen wir auch keinen Menschen, der sich bestehende Kunst anschaut, um von dieser zu lernen. Auch kann noch niemand abschätzen, welchen Einfluss KI-Inhalte schon bald auf das komplette Internet und seine Informationsqualität haben. Dazu kommt mit Deepfake und Co nicht nur das geistige Eigentum, sondern auch direkte Angriffe auf Menschen durch bewusste und unbewusste Fehlinformationen.

Für Künstler sind Tools wie Nightshade zumindest eine erste Möglichkeit, die eigenen Werke vor der KI zu schützen. Wenn auch nur eine größere generative KI daraufhin stärker auf Urheberrechte achtet, ist es trotz des Zusatzaufwands für Künstler ein Erfolg. Auf lange Sicht braucht es aber verbindliche Regeln. Zudem gibt es auch anderes zu bedenken: Schädigt ein Tool wie Nightshade am Ende auch Bild-zu-Text-Software für blinde Internetnutzer? Auch bei der Nutzung solcher Programme muss man mit negativen Folgen rechnen.

Image via DALL-E

Artikel per E-Mail verschicken